“Necesitamos un pacto social para la IA generativa”: la llamada que sale de Madrid a Europa

CONGRESO INTERNACIONAL «Inteligencia Artificial Generativa: retos éticos, jurídicos y sociales.

La Cátedra Internacional ENIA en IA Generativa reúne a las principales voces institucionales y académicas para reclamar que la implementación del AI Act vaya acompañada de nuevas garantías en salud, trabajo y desinformación.

Momento de la inauguración del congreso. De izquierda a derecha, David de Francisco Marcos, Subdirector de IA-Secretaria de Estado de Digitalización e IA; Lorenzo Cotino Hueso, Presidente de la AEPD; Rosa Visiedo Claverol, Rectora de la Universidad CEU San Pablo; Idoia Salazar, Directora de la Cátedra y Presidenta de OdiseIA; Manel Carpio, Socio de Ciberseguridad de Deloitte experto en ética y regulación de la IA; Emiliano Blasco, vicerrector de Planificación Estratégica y Cultura Digital de la Universidad CEU San Pablo; y Ricardo Palomo, Decano y Catedrático Universidad CEU San Pablo. / Darío González.

La IA generativa ha dejado de ser un experimento de laboratorio y ya está tomando decisiones que afectan a diagnósticos médicos, concesión de créditos, campañas políticas o selección de personal; por eso, desde Madrid se reclama un pacto social europeo que combine el despliegue del AI Act con nuevos mecanismos de responsabilidad civil, protección de datos y defensa frente a deepfakes y sesgos algorítmicos.

En el Aula Magna de la Universidad CEU San Pablo, reguladores, académicos y empresas han desplegado el primer mapa con datos de 16 investigaciones pioneras, de cómo esta tecnología ya reconfigura derechos fundamentales, marcos jurídicos, empleo, salud, educación y democracia. Organizado por la Cátedra Internacional ENIA en IA Generativa –en alianza con Deloitte y el Observatorio OdiseIA–, el Congreso Internacional «Inteligencia Artificial Generativa: retos éticos, jurídicos y sociales», los días 10 y 11 de marzo de 2026, ha sido un laboratorio donde se han presentado propuestas accionables para que Europa gobierne este nuevo poder tecnológico. Buena parte de esas 16 investigaciones se ha traducido en las mesas del programa, donde los propios autores han presentado resultados sobre discriminación algorítmica, salud, públicos vulnerables, responsabilidad civil, empleo y desinformación.

El subdirector de IA David de Francisco, de la Secretaría de Estado de Digitalización e Inteligencia Artificial, abrió el congreso planteando que “debemos conseguir que el impacto de la IA generativa sea positivo y transformar todos los sectores generando nuevos modelos de negocio asistidos por IA generativa (IAGen)”. A su lado, la directora de la Cátedra, Idoia Salazar, presidenta de OdiseIA, el Socio de Ciberseguridad de Deloitte experto en ética y regulación de la IA y responsable de la cátedra, Manel Carpio, y la rectora de la Universidad CEU San Pablo, Rosa Visiedo, pusieron foco al evento: pasar del primer momento del hype a la medición rigurosa de impactos y al uso ético y responsable de la IAGen. La Cátedra también pretende establecer alianzas estratégicas con la Comisión Europea o la UNESCO, según expuso Eduardo Martínez de la Fe, director de Tendencias21 (Prensa Ibérica) y responsable del Plan de difusión de la Cátedra.

La conferencia inaugural corrió a cargo de Lorenzo Cotino Hueso, presidente de la Agencia Española de Protección de Datos (AEPD). Hizo notar “que el derecho a la IA se está asentando como tal, de la misma manera que quedaron establecidos, socialmente, el derecho de todos a la electricidad o a Internet”. Cotino enfatizó que el Reglamento General de Protección de Datos (RGPD) y la ley europea AI Act exigen ahora evaluaciones de impacto en privacidad, transparencia algorítmica y mecanismos de unlearning (desaprendizaje automático) para eliminar datos específicos de los modelos.

Igualmente se presentó la plataforma Origin, desarrollada en el interior de la Cátedra. Origin pretende conocer los sesgos de los modelos de lenguaje de IA y de este modo persigue el objetivo de “orientar” al usuario sobre qué modelo “va a usar”, según explicó su desarrollador, Miguel Ángel Liébana, CIO de RIGHT.AI. Junto a él participan en el proyecto investigadores de la Universidad CEU San Pablo como Guillermo de la Calle y Javier Tejedor, responsables del diseño de pruebas y análisis comparados de modelos. Asimismo, se presentó el Plan de capacitación en niños y adolescentes tras el impacto de la IAG, que se desarrolla en el ámbito de la Cátedra por parte de Manuel Vaamonde Moyano, CEO de Funiverse y experto en IA y educación, con la participación del robot que pasea por aulas de toda España atrayendo el interés de las nuevas generaciones por esta tecnología, a las que proporciona herramientas cognitivas para gestionarla adecuadamente.

Las claves del Congreso Internacional «Inteligencia Artificial Generativa: retos éticos, jurídicos y sociales».

Principales retos, impactos y propuestas surgidas del Congreso Internacional «Inteligencia Artificial Generativa: retos éticos, jurídicos y sociales», organizado por la Cátedra Internacional ENIA en IA Generativa en la Universidad CEU San Pablo (Madrid), donde se planteó la necesidad de un pacto social europeo para gobernar esta tecnología. / IA/T21

Ética, sesgos y alucinaciones.

El bloque ético abrió con Richard Benjamins, CEO de OdiseIA y referente europeo en ética de datos, desgranando cómo los sesgos en conjuntos de datos de entrenamiento perpetúan discriminaciones sistemáticas en reclutamiento automatizado, evaluaciones crediticias o generación de imágenes que estereotipan géneros y etnias. “La alternativa puede ser construir tu propio modelo con tus datos y ‘sesgos’ propios o, más sencillo, utilizar un modelo abierto, como Llama”, defendió Benjamins, proponiendo evaluaciones obligatorias, pero manifestándose muy pesimista sobre la gobernanza global ética de la IA: solo hay que mirar cómo está el mundo. Su intervención condensó las conclusiones de los estudios éticos de la cátedra sobre sesgos y casos de uso reales de la IA generativa en reclutamiento, crédito y generación de contenidos.

En salud, los expertos médicos Oswaldo Graña, data scientist especializado en salud, José Antonio Arias y Javier Mendoza, médico especialista y experto en IA aplicada, documentaron chatbots clínicos que superan en precisión diagnóstica a muchos profesionales, pero generan “alucinaciones con apariencia de rigor”. La IA no sustituye el juicio clínico, exige validación continua y protocolos de seguridad del paciente, coincidieron, alertando sobre filtraciones de datos sensibles memorizados por modelos entrenados con historiales clínicos. El trinomio RGPD, AI Act y Data Act forma un ecosistema regulatorio integrado, añadieron, donde la persona debe estar en el centro, manteniendo el componente humano de la relación médico-paciente. Los tres trasladaron al auditorio los hallazgos de las investigaciones clínicas de la Cátedra, que documentan tanto el potencial diagnóstico de los modelos generativos como sus nuevas vulnerabilidades en privacidad y seguridad del paciente.

La catedrática de Derecho Civil Luz María Martínez Velencoso analizó que la IA aumenta la precisión del diagnóstico, anticipa la detección de determinados cánceres, y que 8 de cada 10 sanitarios afirman que la IA salva vidas, según los estudios presentados. La IA seguramente va a ayudar a aliviar el desbordamiento de los servicios sanitarios públicos europeos, siempre que se despliegue con garantías jurídicas y éticas adecuadas.

La profesora Teresa Barceló profundizó en los públicos vulnerables que conviven con fraudes vía deepfakes. Paradójicamente, los mayores –dijo– estamos en ventaja frente a los modelos de lenguaje de IAGen porque tenemos un criterio desarrollado previamente, mientras que los más jóvenes están más expuestos a la confusión entre contenido real y sintético. Este bloque enlazó con los trabajos de la Cátedra sobre impacto de la IA generativa en mayores, personas con discapacidad y otros colectivos vulnerables frente a fraudes y deepfakes.

Interacción con un robot "preadolescente", especialmente programado para el trato con niños. / Darío González

Impacto jurídico y nuevo marco normativo.

El bloque jurídico del congreso volcó las conclusiones de las investigaciones de la Cátedra sobre responsabilidad civil objetiva atenuada, protección de datos y erosión de la propiedad intelectual en la era de la IA generativa. A partir de las propuestas del equipo liderado por Carmen Muñoz García, se discutió cómo pasar de los esquemas clásicos de culpa a un modelo híbrido, donde quien opera sistemas de IA generativa responde por los daños salvo que pruebe haber aplicado estándares técnicos muy exigentes en auditoría, trazabilidad y mitigación de riesgos.

Se abordó el triángulo regulatorio formado por el RGPD, el AI Act y el Data Act como un sistema integrado: el RGPD fija las reglas de licitud y derechos, el AI Act añade gestión del riesgo algorítmico y transparencia, y el Data Act regula el acceso y reutilización de datos para entrenar modelos. Los ponentes analizaron nuevos daños civiles como memorizar y exponer datos personales, crear deepfakes que destruyen reputaciones, automatizar decisiones de crédito o empleo, inferir datos sensibles y generar discriminación algorítmica estructural.

Para aterrizar este debate en un derecho muy concreto, la propiedad intelectual, intervino Cristina Mesa, socia del departamento de Propiedad Intelectual e Industrial de Garrigues, que analizó “el derecho a prohibir el entrenamiento de modelos de IA: pros, contras y dificultades”. Mesa advirtió de que la posibilidad de vetar el uso de determinados contenidos en el entrenamiento choca con la lógica expansiva de los modelos generativos y con la propia arquitectura de Internet, y planteó la necesidad de combinar soluciones jurídicas (nuevos derechos y contratos) con soluciones técnicas como el watermarking y los metadatos de uso.

En esa misma línea, la dimensión de propiedad intelectual fue abordada por Borja Adsuara, abogado y profesor de Derecho Digital en la Universidad Complutense, que centró su intervención en “la IAGen y la erosión de la propiedad intelectual”. Adsuara explicó cómo los modelos generativos se entrenan con ingentes volúmenes de obras protegidas sin una contraprestación clara, y defendió que el futuro pasa por sistemas más transparentes sobre sus datos de entrenamiento y por nuevos mecanismos de compensación a creadores y titulares de derechos en el entorno de la IA generativa.

Se discutieron también los retos en propiedad intelectual y consumo: desde la erosión de los derechos de autor en contenidos generados con IAGen hasta la protección de consumidores y otras personas físicas vulnerables ante sistemas opacos y difícilmente auditables. Las propuestas jurídicas presentadas incluyen un régimen de responsabilidad objetiva atenuada, evaluaciones de impacto obligatorias, auditorías independientes, registros inmutables, seguros, fondos de compensación y mecanismos técnicos de unlearning para corregir daños.

Primera Mesa redonda “Incidencia y prevención de la Discriminación en los sistemas de IA Generativa”. / A. Sacristán.

Impacto social: empleo, desinformación y asistentes universales.

En la dimensión social, las mesas sobre empleo, fake news y asistentes universales de IAGen trasladaron al debate público los resultados de las investigaciones de la Cátedra sobre la llamada “Gran Rotación” laboral, la desinformación sintética y los nuevos hábitos de uso masivo de asistentes generativos. El equipo formado por Ricardo Palomo, Dolores Abuin y Santiago Calvo (Deloitte) presentó una investigación sobre alineación universidad‑empresa tras el impacto de la IAGen, mostrando cómo cambian las competencias demandadas y qué nuevas profesiones emergen. Frank Escandell analizó la incidencia de la IAGen en la aparición de nuevos perfiles profesionales y en la reconversión de los existentes.

La mesa sobre fake news y desinformación, con la participación de María Solano y Tamara Vázquez (Universidad CEU San Pablo), se centró en la escalada de contenidos sintéticos verosímiles y su impacto en la integridad democrática. A partir de los estudios de la Cátedra, se mostró cómo los deepfakes de voz e imagen ya se están utilizando en campañas reales para confundir al electorado, y se reclamó etiquetado obligatorio de contenido sintético y mayor alfabetización mediática.

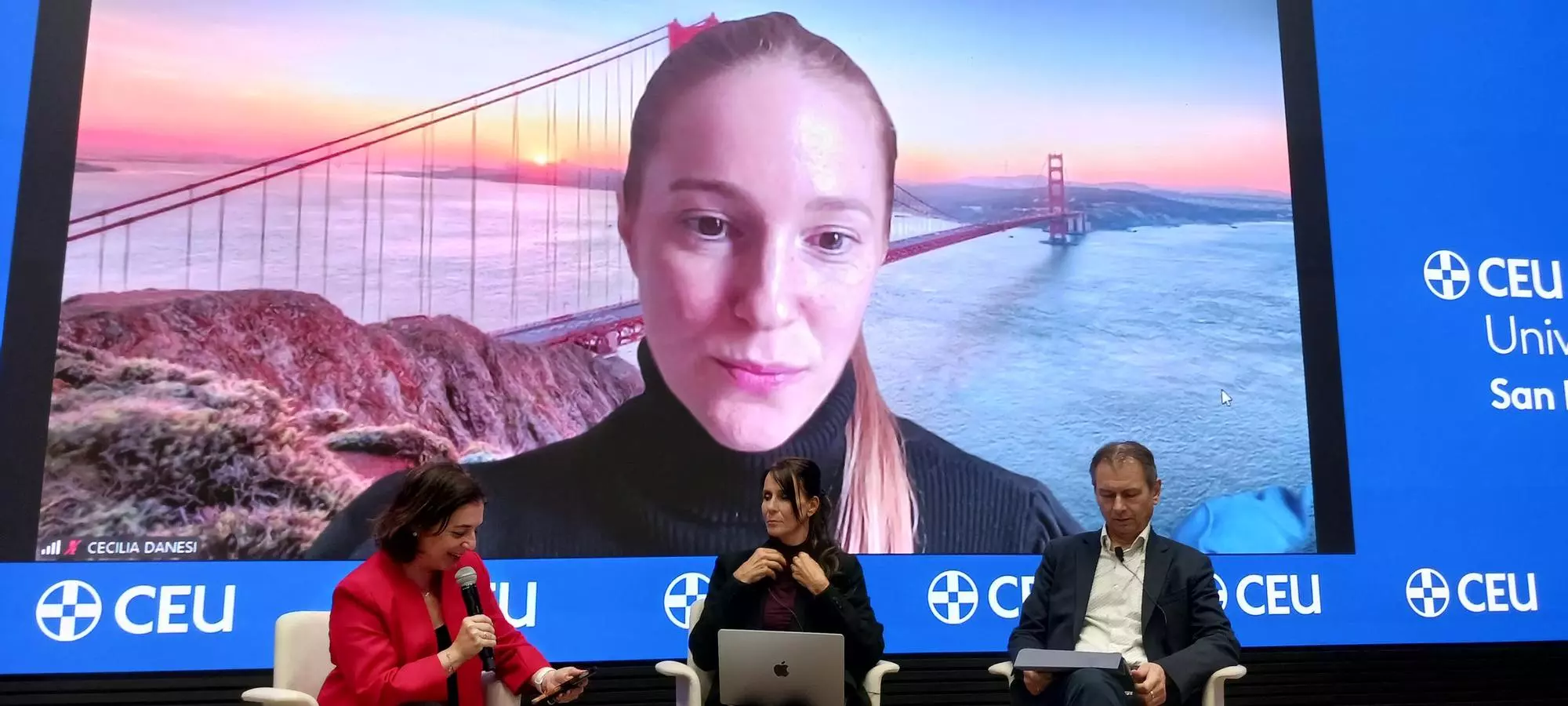

El bloque sobre asistentes universales de IA, moderado por Idoia Salazar, presentó los resultados de una encuesta sobre su impacto social, especialmente en entornos educativos y profesionales. Juan Corvalán, referente en “IA agéntica” y organizaciones centauro, intervino en línea para explicar cómo estos asistentes reconfiguran la toma de decisiones en las organizaciones. En la mesa de debate se discutió la necesidad de combinar innovación con garantías éticas y jurídicas en el despliegue masivo de asistentes.

Hacia un pacto social europeo sobre IA.

Aleida Alcaide, Directora General de Inteligencia Artificial del Ministerio para la Transformación Digital, abrió la segunda jornada enfatizando que “2025 ha sido el año de la generalización de la IA en la sociedad” y que “en España lideramos la implementación responsable del AI Act combatiendo los usos maliciosos como los de Grok, que generan imágenes sexuales no consentidas”. Las evidencias obligan a actuar ya, subrayó, equilibrando innovación con derechos, en un pacto social que Europa necesita urgentemente.

Josetxo Soria, gerente de Asuntos Gubernamentales y Políticas Públicas de IA en Google, clausuró el congreso con unas palabras en las que destacó el progreso de España en IA, así como el compromiso de su empresa con los desarrollos tecnológicos de la Cátedra organizadora de este encuentro.

Esta cátedra fue reconocida unánimemente como el ecosistema donde se está gestando un modelo de IA generativa para Europa, tanto a nivel de investigación, aplicaciones e implantación en la sociedad, teniendo como bandera los aspectos éticos, jurídicos y sociales de esta tecnología que está cambiando el mundo.

Alejandro Sacristán (enviado especial).

Sitio Fuente: Levante / Tendencias21